AI PC挂羊头卖狗肉?大模型困于硬件瓶颈,成熟还需两三年

AI PC 也成了「智商税」?

自从 ChatGPT 在全球范围内引发 AI 风暴后,各类设备迅速与 AI 融合,并将 AI 作为产品的重要卖点,例如汽车、手机、空调、电视、洗衣机,以及本文的主角 PC。

能够提高办公和学习效率,以及生活便捷度的 AI,天生与 PC、手机等设备契合,PC 厂商们纷纷推出了搭载 NPU(神经网络处理器)的 AI PC,而且产品的命名或商品标签还会加上醒目的「AI」字样,就连 Apple 产品京东自营旗舰店的 MacBook,也特地打上了「AI 笔记本」的标签。

(图源:京东截图)

然而在 AI PC 快速普及的今天,依然有许多消费者认为,AI PC 只是智商税,是厂商忽悠消费者更换 PC 的噱头。对此,联想中国消费 PC 及平板事业部总经理李伟昌坦言,部分厂商以搭载 NPU 为卖点,但很多消费者购买了 AI PC 后,却发现没什么可用的 AI 功能,没有得到效率提升。

难道说,AI PC 真的是智商税?

对于 AI PC,联想给出的定义是具备内嵌个人大模型、内嵌个人知识库、本地异构 AI 算力(CPU/GPU/NPU)、开放的 AI 应用生态,以及保障个人隐私和数据安全五大特征,但目前 PC 厂商们的产品大多只能满足本地异构 AI 算力一个特征。

AI PC 的重点在于部署和运行端侧 AI 大模型,可以将隐私数据留在本地设备,并且根据用户的习惯训练大模型,做到更了解用户、更符合用户的喜好和习惯。

常见的 PC 产品一般运行 Windows,若无深度定制,会缺乏 AI 功能。安装豆包、Kimi 等云侧 AI 应用后,AI PC 又与普通 PC 凸显不出差别。为 PC 定制 AI 功能成本不低,纵观国内 PC 市场,在 AI 功能方面做得较好的 PC 厂商,可能只有华为和联想。

(图源:联想)

PC 本身的硬件配置,也限制了端侧大模型的部署,以 DeepSeek-R1 模型为例,7B/8B 参数模型需要 16GB 及以上内存。李伟昌表示,当前主流 PC 依然搭载 16GB 内存,运行 7B 参数模型可能会影响设备的流畅度。内存容量达到 32GB 时,运行 7B 模型才会较为流畅,同时避免影响用户在大模型推理过程中使用其他应用。

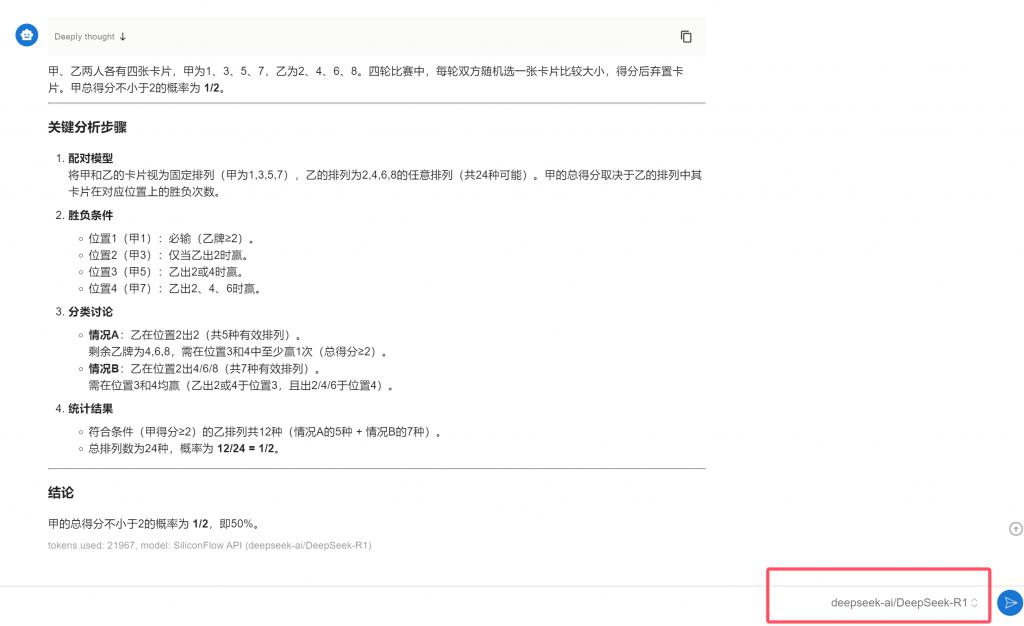

更关键的是,即便 PC 内存达到 32GB,可本地运行 AI 大模型,依然未必能够带给用户很好的体验。小雷找到了 2024 年全国高考Ⅰ卷的一道数学题,做了一个简单的测试,题目为:

甲、乙两人各有四张卡片,每张卡片上标有一个数字,甲的卡片上分别标有数字 1,3,5,7,乙的卡片上分别标有数字 2,4,6,8,两人进行四轮比赛,在每轮比赛中,两人各自从自己持有的卡片中随机选一张,并比较所选卡片上数字的大小,数字大的人得 1 分,数字小的人得 0 分,然后各自弃置此轮所选的卡片弃置的卡片在此后轮次中不能使用则四轮比赛后,甲的总得分不小于 2 的概率为?(正确答案:1/2)

这道题曾一度难倒了众多 AI 大模型,如今几次升级后,如今豆包、Kimi、腾讯混元等大模型,均能计算出正确答案。满血版 DeepSeek-R1 模型同样如此,仅数分钟就计算出了正确答案。

(图源:雷科技制作)

切换至本地部署的 7B 参数 DeepSeek-R1 模型后,同样提出该问题,大模型足足推理了十几分钟,却给出了 1/288 的错误答案。7B 参数的模型可以用,准确率却与满血版相差甚远。想要更好的端侧 AI 体验,就需要部署参数更多的端侧 AI 大模型,而参数更多的端侧 AI 大模型,需要更大的内存和更高的 AI 算力。

自身 AI 功能太少、运行端侧大模型吃力,AI PC 自然显得名不副实,在 AI 体验方面与未搭载 NPU 的 PC 无法拉开明显差距。改变这一局面的重点,在于 AI 大模型和 AI PC 供应链的全面升级。

李伟昌认为,产业链方面存在的瓶颈,导致 AI PC 尚未达到「水到渠成」的阶段。在小雷看来,让 AI PC 摆脱智商税的标签,大模型开发机构、供应链企业、PC 厂商三方面都要发力。

大模型开发机构的任务,是在确保模型能力和准确性的前提下做好优化,或蒸馏出参数更少的模型,减少对内存、算力、显存等硬件的依赖。头部 AI 企业都在尝试蒸馏小模型,谷歌提出的逐步蒸馏(Distilling step-by-step)方法,号称可用 0.77B 参数蒸馏模型打败 540B 参数大模型。

不过就 DeepSeek 不同规模模型的体验而言,小模型与大模型在准确率方面差别很大,小模型上限不足,升级硬件使其可以运行参数量更大的模型,或许才是提高端侧大模型体验的最好方案。

(图源:豆包 AI 生成)

运行端侧 AI 大模型,对于内存和支持 AI 加速能力的芯片有较高要求。供应链企业可通过规模化生产降低成本,但供需问题可能导致产品涨价,近期 SK 海力士、三星等行业巨头已陆续公布了 DRAM、NAND 涨价的消息。

算力芯片方面,AMD 和 Intel 具有 NPU 的 CPU 价格偏高,搭载这些芯片的笔记本电脑也普遍面向中高端市场。但随着产业规模化和技术成熟,如今许多 AI PC 的价格已下探至 5000 元左右价位,如联想 ThinkPad E14、华硕 a 豆 14 Air 悦享版、机械革命无界 15X Pro、七彩虹 源 N14 等,国补后价格不到 5000 元。

但提升用户的工作、学习效率和生活便捷度,只靠大模型的能力和 AI PC 的算力还不够,如何将其与 AI 应用结合,融入用户的工作和日常生活同样重要。

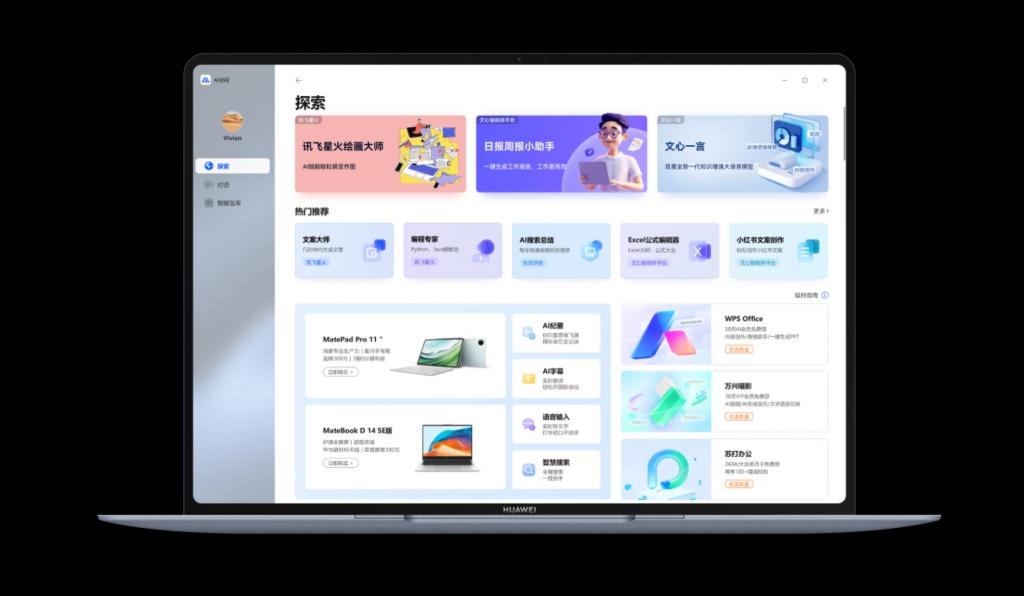

在这方面做得最好的可能是华为,MateBook 基于盘古大模型提供的 AI 能力及小艺智能体,实现了 AI 纪要、AI 慧眼、AI 字幕、智慧搜索等功能,搭配超级终端、超级中转站等互联功能,可大幅提升工作、学习效率。

(图源:华为)

身为全球 PC 行业霸主的联想,推出了天禧 AI 生态「四端一体」战略和个人智能体「小乐同学」。四端一体指 AI PC、AI 平板、AI 手机、AIoT 四类终端设备,一体指用于承担个人任务的个人智能体,以及通过个人智能体将四端融合为一体。

据联想介绍,个人智能体基于大模型的推理能力,可理解用户意图,将复杂任务拆分成子任务链,并支持跨端穿梭,在 PC、手机、平板电脑上协同操作。内嵌 AI 的终端在本身算力基础上,通过压缩和优化 AI 大模型,在裁剪后形成轻量化多模态大模型,以应对各种场景的专业化需求,并降低对硬件的要求,打造个人 AI 助理。

小乐同学还支持智能体轻应用技术,可为开发者开发的各类服务提供端侧大模型能力,强化 AI PC 的实用性。

大模型、AI PC 硬件和软件全部升级,方能让 AI PC 名副其实,向用户提供更加完善的使用体验。这一过程不能一蹴而就,需要全产业链共同发展,实现技术升级和成本下降。

在图文创作、编程、广告营销等行业,AI 已经发挥出了不小的作用,小雷撰写文章时找不到合适的图片,就会使用 AI 生成。金融、医疗、学习等领域,商汤科技、旷视科技、依图科技、云从科技、百川智能等企业入场,开发出了适合专业场景的垂域大模型。

屏幕大、性能强、对开发者友好的 PC,或为个人端 AI 大模型的最佳载体。在 AI 大模型逐渐渗透进我们生活,改变我们工作、学习、生活模式的今天,AI PC 不可能是智商税。

市场调研机构 Canalys 公布的数据显示,2024 年中国大陆地区 AI PC 的出货量已达 580 万台,占 PC 总出货量的 15%,预计 2025 年大中华区 AI PC 市场份额将达到 34%。Canalys 在另一份报告中指出,2024 年第二季度联想 AI PC 出货量环比暴增 228%,也证明了 AI PC 的热销。

AI PC 正逐渐下沉市场,价格愈发实惠,国补的到来进一步降低了消费者购买 AI PC 的成本,双重加持之下,愿意购买 AI PC 的消费者自然会越来越多。市场规模的扩大,则会影响导 PC 厂商和供应链企业,促进 AI PC 及其硬件成本下降,从而形成良性循环,加快 AI PC 产业链成熟。

至于 AI PC 何时能够成熟,《科创板日报》报道称,多位业内人士透露,AI PC 的挑战主要在内存、芯片等上游产业链,成本控制和规模化方面仍需优化,按照产业升级周期规律,预计 2-3 年产业链能够趋近成熟。